Pengenalan

Di era digital saat ini, penyebaran informasi yang cepat dan luas membawa tantangan tersendiri, terutama dalam hal hoaks. Hoaks dapat merusak reputasi individu, perusahaan, dan bahkan dapat mempengaruhi stabilitas sosial. Oleh karena itu, upaya untuk mendeteksi hoaks menjadi sangat penting. Salah satu pendekatan yang menjanjikan adalah penggunaan model transformer seperti BERT, ALBERT, dan RoBERTa.

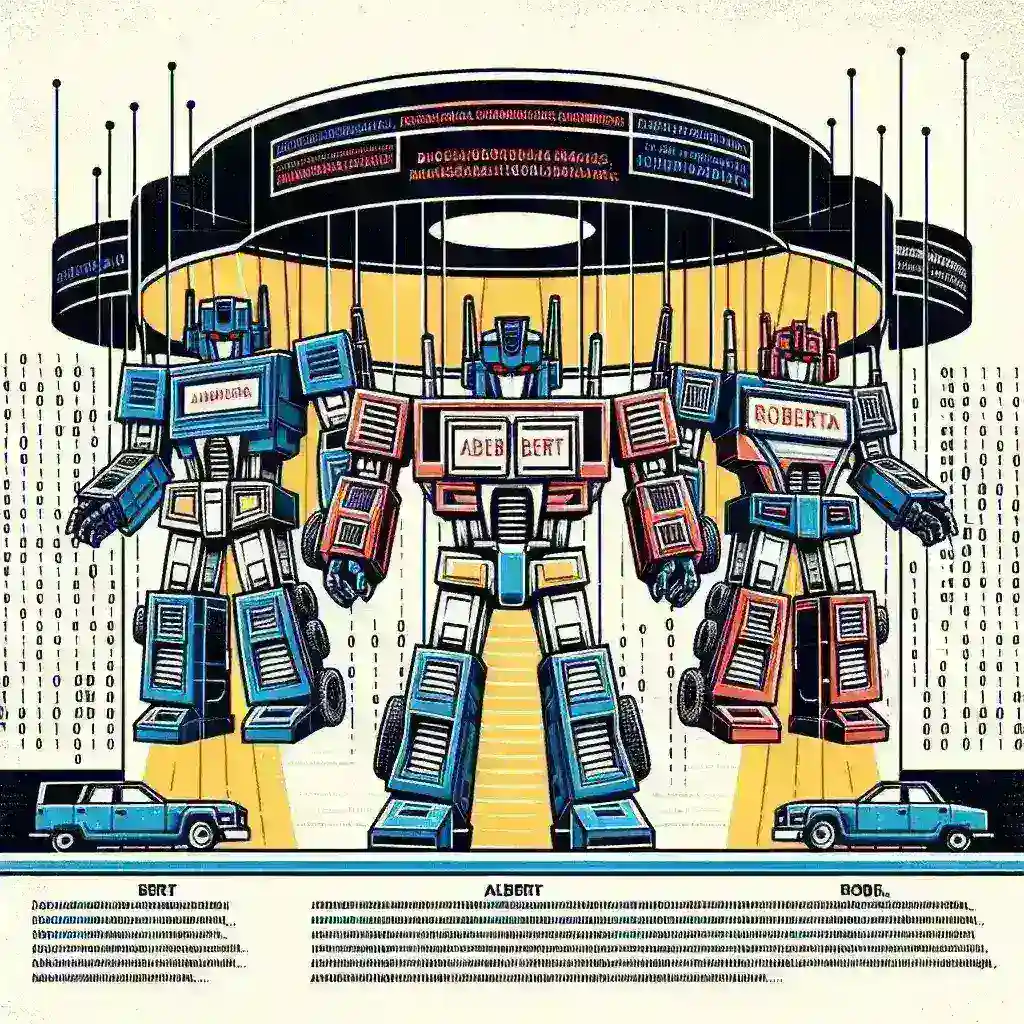

Apa itu Model Transformer?

Model transformer adalah arsitektur pembelajaran mesin yang diperkenalkan dalam makalah berjudul “Attention is All You Need” pada tahun 2017. Model ini menggunakan mekanisme perhatian (attention mechanism) untuk memproses data secara lebih efisien dan efektif daripada model-model sebelumnya. Dengan kemampuan ini, model transformer telah merevolusi berbagai aplikasi dalam pemrosesan bahasa alami (NLP).

Sejarah Singkat BERT, ALBERT, dan RoBERTa

BERT (Bidirectional Encoder Representations from Transformers) adalah salah satu model transformer pertama yang digunakan secara luas dalam NLP. Model ini diluncurkan oleh Google pada tahun 2018 dan menjadi salah satu tonggak penting dalam pengembangan teknologi NLP. ALBERT (A Lite BERT) adalah versi yang lebih ringan dari BERT, yang dirancang untuk mengurangi penggunaan memori dan meningkatkan kecepatan pelatihan dengan tetap mempertahankan performa yang baik. RoBERTa (Robustly optimized BERT approach) adalah penyempurnaan dari BERT yang mengoptimalkan berbagai parameter dan teknik pelatihan untuk mencapai hasil yang lebih baik.

Kemampuan Deteksi Hoaks

Ketiga model ini telah terbukti efektif dalam mendeteksi hoaks berbahasa Indonesia. Dengan memanfaatkan data teks yang besar dan beragam, model-model seperti BERT, ALBERT, dan RoBERTa dapat memahami konteks, makna, serta nuansa dari sebuah berita atau informasi.

Proses Deteksi Hoaks

Proses deteksi hoaks menggunakan model transformer terdiri dari beberapa langkah:

- Pengumpulan Data: Mengumpulkan dataset berisi berita dan informasi yang dikategorikan sebagai hoaks atau fakta.

- Preprocessing: Membersihkan dan memformat data agar sesuai untuk pelatihan model.

- Pelatihan Model: Menggunakan dataset yang telah diproses untuk melatih model BERT, ALBERT, atau RoBERTa.

- Evaluasi Model: Menguji kemampuan model dalam mendeteksi hoaks menggunakan data baru.

- Implementasi: Menerapkan model dalam aplikasi nyata untuk mendeteksi hoaks secara otomatis.

Keunggulan Model Transformer dalam Deteksi Hoaks

Terdapat beberapa alasan mengapa model transformer seperti BERT, ALBERT, dan RoBERTa sangat efektif dalam mendeteksi hoaks:

- Kemampuan Memahami Konteks: Model ini dapat memahami konteks kalimat secara lebih baik, sehingga dapat membedakan antara informasi yang benar dan salah.

- Transfer Learning: Model-model ini dapat dipelajari dari dataset yang lebih kecil setelah dilatih pada dataset yang lebih besar, sehingga mempercepat proses pelatihan.

- Fleksibilitas: Dapat disesuaikan untuk berbagai bahasa, termasuk bahasa Indonesia.

Tantangan dan Kendala

Meskipun model-model ini menawarkan banyak keunggulan, terdapat beberapa tantangan yang harus dihadapi:

- Kualitas Data: Kualitas dataset yang digunakan sangat mempengaruhi akurasi deteksi. Data yang tidak akurat atau tidak representatif dapat menghasilkan model yang buruk.

- Perubahan Bahasa: Bahasa terus berkembang, sehingga model perlu diperbarui secara berkala agar tetap relevan.

- Resistensi Pengguna: Masyarakat terkadang enggan menerima hasil dari model deteksi hoaks, sehingga meningkatkan tantangan untuk mengedukasi publik.

Masa Depan Deteksi Hoaks dengan Model Transformer

Ke depan, penggunaan model transformer dalam deteksi hoaks berbahasa Indonesia akan semakin berkembang. Dengan kemajuan teknologi dan peningkatan kualitas dataset, diharapkan model-model ini dapat mendeteksi hoaks dengan lebih akurat dan cepat. Penelitian lebih lanjut juga diperlukan untuk mengatasi tantangan yang ada dan meningkatkan kemampuan model.

Keterlibatan Masyarakat

Penting bagi masyarakat untuk terlibat dalam upaya deteksi hoaks. Edukasi mengenai cara mengenali hoaks dan pentingnya verifikasi informasi dapat membantu menciptakan masyarakat yang lebih kritis dan sadar akan berita yang beredar. Dengan demikian, meskipun teknologi dapat membantu, keterlibatan manusia tetap menjadi elemen kunci dalam memerangi hoaks.

Kesimpulan

Model transformer seperti BERT, ALBERT, dan RoBERTa telah terbukti efektif dalam mendeteksi hoaks berbahasa Indonesia. Dengan kemampuannya untuk memahami konteks dan menerapkan teknik pembelajaran mesin yang canggih, model-model ini menawarkan solusi yang menjanjikan dalam menghadapi tantangan informasi di dunia digital. Meskipun masih terdapat tantangan yang harus diatasi, prospek masa depan penggunaan teknologi ini dalam deteksi hoaks sangat cerah, dan keterlibatan masyarakat menjadi kunci utama dalam menciptakan lingkungan informasi yang lebih sehat.